今天的主題是AI如何幫助許多想申請美國本科的同學。

我將來簡要介紹下AI的演進道路。大家可能聽到過許多AI領域的詞匯,例如鼎鼎大名的AI,以及最近非常火爆的生成式AI,無論是之前的機器學習(xi) 還是神經網絡,深度學習(xi) ,都是耳熟能詳。

早年間AI在計算機領域,大家都是用所謂的專(zhuan) 家係統,我們(men) 給計算機提供一係列指令,計算機根據指令完成工作,並給到一個(ge) 非常確定的輸出。我讓它做a時,它一定會(hui) 給a的具體(ti) 輸出,直到2012年時可能有些變化。

以人臉識別為(wei) 例,2012年有一幫科學家,主要來自加拿大滑鐵盧的流派。他們(men) 可能原來會(hui) 被認為(wei) 是旁門左道,他們(men) 是用神經網絡來做人工智能,做人臉識別。到2012年,這一派異軍(jun) 突起,識別率遠超傳(chuan) 統做法。從(cong) 2023年到今年,Open AI又推出了很多包括Sora這樣的文生圖、文生視頻這樣的東(dong) 西,大概是這樣邏輯。

什麽(me) 是人工智能(AI):

我們(men) 看到大的框架是我們(men) 叫artificial,下麵的機器識別是AI的一個(ge) 子集,然後深度學習(xi) 又是機器識別的一個(ge) 子集,深度學習(xi) 用到了神經網絡作為(wei) 它的一個(ge) 基礎結構,然後再一個(ge) 子集就是我們(men) 說的生成式的人工智能。

首先我們(men) 討論人工智能,即AI可以執行,通常需要人類的智能才能完成的事情。人工智能是一個(ge) 大的概念範疇。

接下來我們(men) 將討論機器學習(xi) ,前麵提到機器學習(xi) 是人工智能的一個(ge) 子領域,具體(ti) 指什麽(me) ?指的是從(cong) 數據中學習(xi) 和改進,而不需要我們(men) 之前提到的明確編程指定它們(men) 完成任務,這與(yu) 傳(chuan) 統專(zhuan) 家係統有所區別。前麵提到了專(zhuan) 家係統是我告訴它做這個(ge) 事情,它就嚴(yan) 格按照我告訴它的指令來執行,新一代的人工智能是說我從(cong) 數據中去學習(xi) ,然後自己自發的去做一些決(jue) 策。

比如說ChatGPT,給它一個(ge) 提示詞,然後它就會(hui) 產(chan) 生一篇文章,很有趣的是這個(ge) 提示詞每次產(chan) 生出來的文章是不一樣的,如果按照以前的專(zhuan) 家係統,你給它應該每次都一樣。因此,你可以將其視為(wei) 一個(ge) 人工助手。這就是新一代人工智能每次都會(hui) 給你不一樣文章的原因。

深度學習(xi) 又是機器學習(xi) 的一個(ge) 子集,關(guan) 鍵是它用到了一個(ge) 神經網絡,神經網絡就是模擬人的腦子,有好多層的結構,然後在不同層裏麵有不斷來回參數的傳(chuan) 遞,然後做了大量參數傳(chuan) 遞以後,它就模擬人的頭腦的思維方式來給出人的學習(xi) 過程的一個(ge) 模擬,大概是這個(ge) 邏輯。

它其實基本上是靠計算機算法來完成中間很多的優(you) 化和參數傳(chuan) 遞。舉(ju) 個(ge) 例子,比如它叫梯度下降,是作為(wei) 一個(ge) 算法,就是來達到一個(ge) 局部區域的最優(you) 化,然後它不同層的參數傳(chuan) 遞,我們(men) 叫反向梯度或者反向傳(chuan) 遞和正向傳(chuan) 遞,當然這都是算法,這裏麵大量的用到數學裏麵的偏微分方程和矩陣運算,基本上就是一個(ge) 數學下麵大量的這種工作。所以它不是說真要怎麽(me) 樣去跟人的神經科學和醫學的部分去結合,它還是在計算機跟數學這個(ge) 層麵上的這種工作。

一個(ge) 神經網絡,由很多個(ge) 層次的神經元節點組成,它有很多的權重,有很多的算法,反向、正向的參數傳(chuan) 遞,包括一些梯度下降的很多的算法在裏麵。

大概前年到去年出來的生成式AI,舉(ju) 個(ge) 例子,比如說有這樣一個(ge) 環境,我會(hui) 說這樣的話,我說今天外麵下雨了,我出門要戴一戴,然後後麵一個(ge) 空格內(nei) 填什麽(me) 詞,然後比如說大語言模型就會(hui) 填,帶雨傘(san) 的概率,它會(hui) 填85%,然後雨衣可能填10%,然後帶上車鑰匙5%,所以其實是它學習(xi) 了大量的人類語言的案例後,它根據上下文會(hui) 自動往裏麵填句子填段落,這大概就是生成式AI的基本邏輯。

你就記住一點,就是說今天外麵下雨了,我要帶什麽(me) 東(dong) 西,大語言模型會(hui) 往裏麵填,按照概率來填這個(ge) 東(dong) 西,這個(ge) 概率怎麽(me) 得來,就是根據它學習(xi) 了大量的人類文獻以後得出的結論,這個(ge) 邏輯就是你喂的東(dong) 西越多越靠譜,它學習(xi) 出來的質量就越高,其實和我們(men) 人類的學習(xi) 一樣。

總結人工智能是一個(ge) 大的概念,機器學習(xi) 是人工智能一個(ge) 子集,是通過數據學習(xi) 和改進,深度學習(xi) 就是機器學習(xi) 的一個(ge) 子集,它是用神經網絡來做的,然後神經網絡的話,前麵講的是一係列算法和神經元的層次結構搭起來,然後生成式AI是基於(yu) 深度學習(xi) 到一定時間段的一個(ge) 產(chan) 物,它是能夠通過學習(xi) 大量的曆史數據來產(chan) 生新的內(nei) 容,大概是這個(ge) 邏輯。

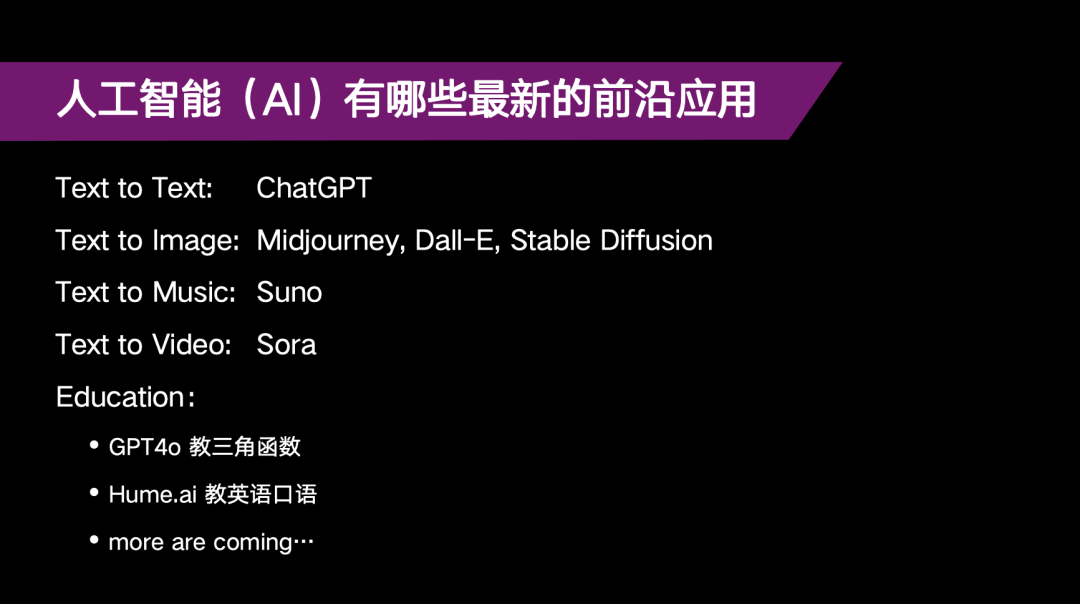

簡要介紹目前人工智能中有哪些優(you) 秀應用:

Text to Text: ChatGPT

Text to Image: Midjourney, Dall-E, Stable Diffusion

Text to Music: Suno

Text to Video: Sora

在教育行業(ye) 上的運用。前一陣,有一個(ge) 視頻是可汗學院的創始人,他用GPT教他的自己的小孩三角函數,大概是GPT4o,就已經展現出能夠教小朋友三角函數,乃至將來可能更複雜的一些教學的任務,它體(ti) 現出來不光是會(hui) 教,還會(hui) 跟你做一些交流。一步一步的來教你,這就真的很厲害。

第二個(ge) 就是現在可能因為(wei) 大家升學壓力都很大,會(hui) 找很多的老師來做培訓,如果有一個(ge) AI的老師來教學生,第一個(ge) 它會(hui) 很耐心,第二個(ge) 它可能費用更低,第三個(ge) 它對小朋友掌握的程度了解更深,它如果從(cong) 5歲教到小朋友20歲,一路以來會(hui) 對小朋友非常熟悉。它知道小朋友的缺點,它有耐心,它隨時可以觸達,小朋友有空的時候它就有空,這個(ge) 可能會(hui) 帶來很大的顛覆。

比如,Hume.ai教英語口語,它裏麵有幾個(ge) 模擬的人物,比如說一個(ge) 教英文口語的老師,它就跟你聊聊英文,它有很多的提示詞,對教小朋友英語口語非常好,因為(wei) 它跟以前有了質的變化,它是有感情的,它有語氣,你可以隨時打斷他。

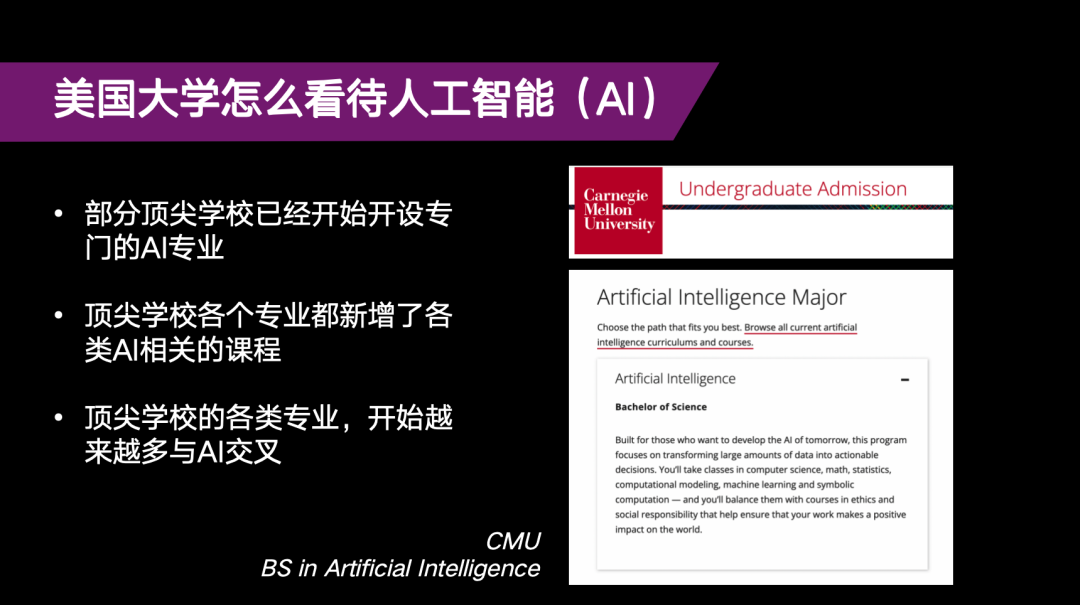

關(guan) 於(yu) 美國大學怎麽(me) 看待人工智能(AI):

第一個(ge) ,美國的大學目前非常重視人工智能,有一些頂尖大學已經開設了人工智能專(zhuan) 業(ye) ,比如說卡內(nei) 基梅隆CMU,它的計算機學院是新成立、單獨成立的一個(ge) 學院,它在計算機學院裏麵成立了AI專(zhuan) 門的專(zhuan) 業(ye) 。

AI這個(ge) 領域發展非常快,所以大學在努力的跟。很有趣,實際上這波是業(ye) 界在推動,業(ye) 界頂在最前麵,然後學術界也在跟,而且AI很大程度上影響到了學術界。所以像斯坦福也好,MIT也好,都肯定在計算機科學上麵開了相關(guan) 的人工智能的課程和一些細分方向,或者開了很多的Lab,比如說MIT開了AI相關(guan) 的Lab,就鼓勵學生在技術和人文、商科、生命科學領域的一些交叉。

QA時間

Q:AI在未來可能會(hui) 有什麽(me) 樣的進化趨勢?我們(men) 如何能夠跟上AI新的變革?

A:跟得緊一點,有很多的論壇文章,很多的網站都可以去跟的,去關(guan) 注最新的科普,最新的專(zhuan) 業(ye) 發展。其實國內(nei) 已經跟得很緊,目前國內(nei) 的很多自媒體(ti) ,一個(ge) sora出來的話,第二天都是sora的信息了。

AI在未來的發展,就像前麵講的有兩(liang) 次很大的意外,第一個(ge) 是加拿大派衝(chong) 出來說可以疊神經網絡,原來矽穀一派的是沒想到,等於(yu) 是加拿大派占領了這個(ge) 領域,然後整個(ge) 矽穀再去學的。第二個(ge) 變化,比如說Google的話一開始沿著自己思路搞AI,根本沒想到Open AI會(hui) 大力出奇跡,行業(ye) 有很多有趣的異軍(jun) 突起的現象,也正是因為(wei) 這樣,才讓這個(ge) 領域充滿了意思,你也有彎道超車的機會(hui) 。

Q:學習(xi) AI需要多久?對於(yu) 小朋友來說,以這種課程的維度上來講,大概要花多長時間是能夠有基本的了解。

A:取決(jue) 於(yu) 你想學多深。如果你想從(cong) 事計算機領域,你想做AI研究的話,可能要研究深一點,如果是其他的領域,你想和AI做一個(ge) cross的話,可能就不用那麽(me) 深,但是你學好了AI,你可以比在那個(ge) 領域的很多沒有學過的人擁有很大的優(you) 勢。

小學生們(men) 玩一玩就好了,可以從(cong) 初中開始學。一般AI的課程就可以,基本的一些python編程可能需要學一學,也不用很長時間,比較複雜的點是在於(yu) 怎麽(me) 把你的興(xing) 趣和AI結合起來,因為(wei) 這裏麵要找一個(ge) 結合點,是需要動點腦筋的,就不是說每一個(ge) 都一樣,比如說心理學和AI結合,可能是大量的細分領域的數據采集收集,然後喂給AI,做這個(ge) 方案,讓AI變成一個(ge) 心理學方麵的專(zhuan) 家,再幫助那些有這方麵心理問題的小朋友解決(jue) 他們(men) 的問題,整個(ge) 流程是需要動腦子的。

Q:如果對AI編程感興(xing) 趣,會(hui) 有什麽(me) 樣的課程可以推薦?

A:幾塊。基本的Python可以學,學一些基本的, 對於(yu) AI一些概念的了解,然後一些基礎原理不用學太深,你不需要學到矩陣運算、偏微分方程、梯度下降法,這個(ge) 不需要,但是你需要大概了解這些是怎麽(me) 弄的。比如神經網絡之間的話為(wei) 什麽(me) 要傳(chuan) 參數?這個(ge) 來回傳(chuan) 參數的邏輯是什麽(me) ?

最後它輸出是一個(ge) 概率值,然後有哪些情況下它會(hui) 有一些over fit?或者是過擬合。你需要知道一些基本的邏輯,還有最新的那些邏輯,你需要去學習(xi) 如何寫(xie) 好一些提示詞,因為(wei) 如果你想用好ChatGPT,要用好文生圖,提示詞寫(xie) 的質量越高,AI就能夠幫助你產(chan) 生更高質量的文章和圖像。

Q:最新的AI一定程度上能模擬人類的情感,這個(ge) 和人類的情感會(hui) 存在什麽(me) 樣的差別呢?

A:模擬人類情感,它實際上是一種概率輸出,就在這種語境情況下,85%的人類會(hui) 表示憤怒,10%的人類表示沮喪(sang) ,5%的人類表示絕望,那它就會(hui) 產(chan) 生這樣的輸出。

Q:如果小孩大學還是想學計算機,想學CS,需要做一些什麽(me) 有深度的項目會(hui) 比較有幫助?

A:我們(men) 有個(ge) 小朋友,他要申請CS以及Double E,他CS和Double E都拿到了,最後他去了Double E,因為(wei) 最近芯片行業(ye) 是最牛逼的。有一種說法,可能將來基礎的編程人員會(hui) 受到AI很大衝(chong) 擊,但是Double E的話跟芯片相關(guan) ,他最後去了一個(ge) 美國很好的學校的頂尖學校的Double E,他做什麽(me) 事情呢?他裝了個(ge) 攝像頭,然後特斯拉跑的時候他收集很多數據,這個(ge) 攝像頭也收集很多數據,兩(liang) 個(ge) 做一個(ge) 交叉驗證,他就希望去模擬特斯拉的一些數據,這是他做的一個(ge) 項目,這個(ge) 項目是半成品。

因為(wei) 特斯拉的人工駕駛它是一個(ge) 純基於(yu) 攝像頭的,國內(nei) 很多自動駕駛,兩(liang) 套係統攝像頭也有,激光雷達也有,毫米波雷達也有,這些都有,特斯拉是純基於(yu) 攝像頭的,所以他想做的是部分特斯拉的自動駕駛的一個(ge) 視覺識別的功能。

蘋果手機有三個(ge) 攝像頭,有三個(ge) 洞,最新的iphoness15,如果大家打開它的錄製視頻,它有個(ge) 功能,點一下,它就生成一個(ge) 有景深的視頻,人的眼睛是兩(liang) 個(ge) 眼睛,其實兩(liang) 個(ge) 眼睛長得越分開越好,它越分開,它就越能去識別物體(ti) 的立體(ti) 性,兩(liang) 邊可以照到物體(ti) 的立體(ti) 性,即景深。它越分開,拍攝出來景深的信息就會(hui) 更多。

有個(ge) 小朋友在做這樣一個(ge) 項目,他做一個(ge) 兩(liang) 個(ge) 攝像頭分得很開的這樣一個(ge) 東(dong) 西,然後做成很多景深的東(dong) 西。這樣有景深的視頻有什麽(me) 用?目前的話應用程度有限,因為(wei) 可呈現的方式不是很多,將來比如說你戴一個(ge) 眼鏡,你之前用這個(ge) 寬的攝像頭拍,它能夠更加的有景深和立體(ti) 化。

這樣講類似你可以拍攝3D電影。所以小朋友在做這樣的一個(ge) 項目,可以有一定跟CS,Double E的深度結合,因為(wei) 會(hui) 用到一些計算機視覺裏麵的東(dong) 西了,大概是這樣。當然這個(ge) Approach不一定成立,但是小朋友有欲望去想往這邊探索,這本身證明了小朋友的探索價(jia) 值。這個(ge) 方向有可能是完全是錯誤的,但是沒有關(guan) 係

評論已經被關(guan) 閉。